Ollama vs LM Studio 2026 香港完整比較:哪一個更適合你?

![Ollama vs LM Studio 2026 香港完整比較:哪一個更適合你? ollama lm studio llm studio vs ollama ollama和lm studio lm studio和ollama ollama lmstudio lmstudio ollama ollama vs lmstudio lm studio ollama 比较 lmstudio vs ollama lm studio or ollama ollama or lm studio llm studio ollama lm studio訓練 lm studio vs ollama 对比 lm studio vs ollama performance lm studio vs ollama mac lm-studio lm studio是什麼 lm studio教學 anythingllm vs lm studio ollama vs llm studio lm studio and ollama ollama lm studio 比较 lm studio + stable diffusion lm studio中文模型 lm studio with ollama lm vs llm lm stdio ollama教學 stable diffusion lm studio ollama studio lm stuidio lm studio ai lm studo lm studio use ollama lm studio ollama models ollama vs vllm lm studio ollama 对比 lm studio 对比 ollama 什麼是ollama anythingllm vs ollama lm studio vs vllm ollama llm studio ollama vs llm lmstufio ai lm studio jan vs lm studio lm studio api ollama vs anythingllm lm studio/ollama lm studio ollama server lm studio rag anythingllm vs jan llm studio 教學 lm studio cline ollama deepseek ollama vs llmstudio better than lm studio lmdeploy vs ollama lmstudio vllm 本地大模型推荐 anythingllm vs lmstudio vllm windows lmstudio android ollama 功能 llm studio lm studio是什么 lmstdio lm studio 中文 lm stuido ollama介紹 ollama是什么 lm studio ollama api ollama lm studio 比較 lm stduio lm sudio ollama模型推薦 lm studio vllm lm studion lmsudio lmstduio lm stidio o3 mini ollama ollama 介紹 vllm vs ollama what are the main differences between ollama and lm studio vllm vs lm studio lmstudio vs lm studio\ lm sutdio lm stufio lm studio應用 lm stuio lmstuidio lm studio. ollama 类似的工具 linux lm studio lm studio中文界面 ollama 对比 ollama vs lm studio comparison lm studio vs ollama comparison lm stadio what are the main differences between lm studio and ollama lm studio, lm studii lm studio vs olama ollama 商用 studio lm llmstudio lm studio avx ollama訓練 ollama vs lm studio speed lm studeio lm sstudio ollama 定義 vllm lm studio o3-mini ollama lm studio android lm studio 是什么 ollama vllm 比較 lm studio 模型推荐 lm studio ubuntu llm模型比較 lm studio proxy lm studip lmstudip ollama lm llm stuido jan ollama https://lmstudio.ai/ ollama stable diffusion lm stodio lm stdui lm studios 类似ollama lm studio mllama lm.studio lm studui ollama deepseek r1 lm atudio lmstuido ollama-lmstudio-bridge "lm studio" lm平台 ollama 是甚麼 ollama avx2 lm studio plugins ollama 硬體需求 vllm ollama 对比 anything llm ollama which is better ollama or lm studio ollama是哪个公司的 ollama vs lm studio vs jan ollama with lm studio llm比較 lm studio anything llm lmstudio mllama anythingllm vs lm studio' 開源大模型 lm studia lm studiio lm studio definition lm studioi lmstuio lm studio vs chatgpt lm syudio l m studio llmstudio vs ollama lm sttudio lm studiop jan ai vs ollama lm studio equivalent lmstudio api anything llm vs ollama lm studio use ollama model lm studio https lm stusio lmstudio linux ollama多卡 lm studop ollama vs jan.ai lm studio visual studio stable diffusion 模型推薦 lm studio connect to ollama lmstudio mcp lm llm ollama 訓練 vllm和ollama对比 ollama中文 lmstudio or ollama ollama模型推荐 ollama 是什么 anythingllm api lm studio llama ollama是啥 lm studio web ui alternativas a lm studio deepseek r1 ollama llama3.3 lm studio local server lm studio server lm studio use gpu olama ollama 是啥 phi4 14b difference between ollama and lm studio llama deepseek llama studio llm vs ollama ubuntu lm studio llama 3.1 llama 3.2 lm studio for mac lmstudio 商用利用 ollama vllm ollama繁體中文 大型語言模型比較 better than ollama lllm studio llm stduio lm strudio lm studio vs anything llm lmstudeio lmsutdio ollama 生成圖片 gpt 類似 lm srudio lm studio benchmark lm studio n8n lm studio] lm sutio lm_studio lmatudio lmstudoi lmtudio n8n ollama ollama jan ollama to lm studio lm studio model lm studio pdf lm studoi lm stutio lm tudio lmstudio stable diffusion lmstuduo ollama vllm 对比 ollama 模型推荐 chatbox vs lm studio gguf vs mlx lm studio mcp lm studio tokens lm studio vs jan ai lms tudio ollama avx ollama dall-e ollama models in lm studio vllm vs ollama speed diffusion lm google lm studio jan ai vs lm studio lm studio plugin lm studio.ai lmstudio mac lmstudio tools lmstudion ollama mac部署 ollama on m1 ollama use lm studio models stable diffusion in lm studio stable diffusion on lm studio vllm ollama llm 開源 lm studio for linux lm studio vs ollama reddit lmsutido ollama vs llama cpp vs lm studio lm studio beta lm studio debian lm studio google ollama midjourney ollama 中文模型 ollama 使用方法 ollama 公司 ollama 如何使用 ollama 用途 ollama 訓練模型 vllm vs ollama performance lm studio vs anythingllm lm studio? lmstudio macos lmstudui ollama translation lm studio price ollama visual studio claude 3.5 sonnet gguf lm studio vs oobabooga llm 比較 jan vs ollama intel gpu ollama ollama 性能 lm studio mlx ollama 本地部署 大語言模型排名 lm studio 介绍 huggingface lm studio lm studio 联网搜索 ollama 本地 is ollama better than lm studio lm studio web search ollama and lm studio deepseek ollama ollama 中文 chatgpt模型差異 chatgpt 付費 ai 模型比較 ollama教學windows lm studio vs gpt4all ollama wordpress lm ai ollama使用 llm studio alternative](https://www.hdcourse.com/wp-content/uploads/2024/04/Untitled-design.png)

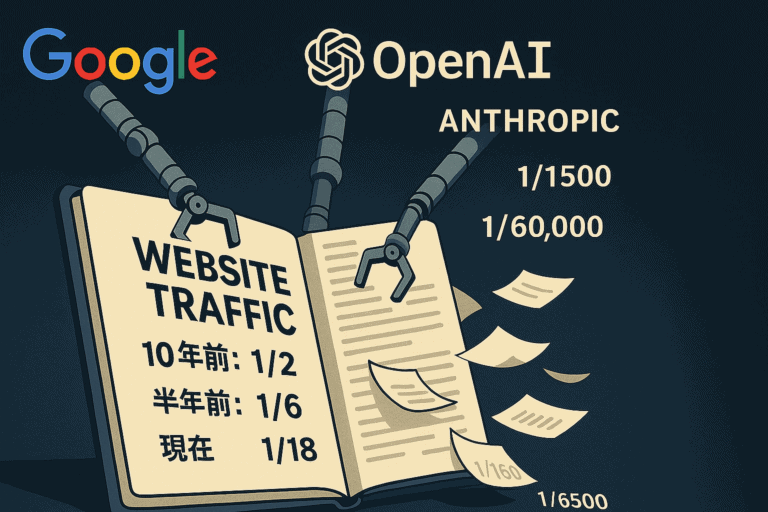

為什麼 2026 年香港用戶要認識本地 AI 模型?

過去兩年,AI 工具的普及速度令人驚嘆。ChatGPT、Claude、Gemini 等雲端服務固然方便,但對於香港的中小企業主、數碼行銷人或自由工作者而言,將客戶資料、財務數據或商業機密上傳至海外伺服器,始終是一個難以忽視的風險。

本地 AI 模型(local AI models)正好解決這個痛點:所有運算在自己的電腦完成,資料從不離開本地設備。而市場上最受歡迎的兩個本地 AI 工具,就是 Ollama 和 LM Studio。

在香港,隨著各行各業對 AI 效率工具的需求急速增加,懂得選擇合適的本地 AI 工具已成為職場競爭力的一部分。

Ollama 是什麼?

Ollama 是一個開源、以命令列為主的本地大型語言模型(LLM)執行框架。用戶只需在終端機(Terminal)輸入簡單指令,即可下載並執行 Llama 4、DeepSeek R1、Gemma 3 等主流開源模型。Ollama 由 Y Combinator(Winter 2021)支持,現已獲 Opera 瀏覽器及 Microsoft PowerToys 等主流軟件整合,是開發者社群的首選基礎架構。

核心特點:

完全免費開源,無任何使用限制

以 REST API 形式運行,與 OpenAI API 格式相容,方便整合到現有工作流程

支援 多模型並行載入,適合需要同時調用多個模型的自動化任務

2025 年 7 月推出 macOS 及 Windows 原生桌面應用程式,介面簡潔,支援拖放 PDF 及圖片

GPU 加速支援 NVIDIA、AMD 及 Apple Silicon

LM Studio 是什麼?

LM Studio 是由前 Apple 工程師 Yagil Burowski 於 2023 年 5 月創立、Element Labs 出品的本地 AI 桌面應用程式。其最大賣點是精美的圖形介面(GUI),讓完全沒有程式開發經驗的用戶都能輕鬆下載、載入模型並即時聊天。自 2025 年 7 月起,LM Studio 個人及商業使用完全免費,企業版則提供 SSO 登入及模型管理功能。

核心特點:

視覺化模型瀏覽器,直接搜尋及下載 Hugging Face 上的模型

內建聊天介面,開箱即用,無需輸入任何指令

版本 0.4.0 新增 headless server 模式,可作為 API 伺服器在背景執行

支援 PDF 文件讀取、網頁搜尋插件、LM Link 遠端連線

OpenAI 相容 API(localhost:1234)

Ollama vs LM Studio 2026 詳細比較表

以下是針對香港用戶需求整理的全面比較,協助你一目了然做出最佳選擇:

| 功能項目 | Ollama | LM Studio |

|---|---|---|

| 安裝難度 | 中等 — 需在終端機輸入指令,2025 年後新增桌面 App 令安裝更容易;但初學者仍需一些學習 | 簡單 — 下載安裝程式、點擊安裝,即可使用。無需任何命令列知識,完全適合非技術用戶 |

| 支援模型 | 官方精選模型庫(Llama 4、DeepSeek R1、Gemma 3、Qwen 3、Phi-4、Mistral 等),數量精而準 | 直接搜尋整個 Hugging Face 模型庫,選擇更廣泛;支援所有 GGUF 格式模型,包括冷門特化模型 |

| 使用介面 | 命令列為主(CLI);2025 年 7 月新增輕量桌面 App,功能基本但簡潔,支援拖放圖片/PDF | 業界最精緻的 GUI,視覺化聊天介面、模型管理、設定面板一應俱全,學習曲線極低 |

| API 支援 | 完整 OpenAI 相容 REST API,支援 streaming、tool calling、JSON schema、embedding,適合程式整合 | OpenAI 相容 API(localhost:1234),0.4.0 版本後支援 headless 模式;單次只能載入一個模型,靈活度較低 |

| 硬件需求 | 系統佔用較低(約 100MB 閒置記憶體);支援 Intel Mac、Apple Silicon、NVIDIA、AMD GPU;CPU 模式亦可執行輕量模型 | GUI 本身需額外 500MB+ 記憶體;不支援 Intel Mac;部分版本有 GPU 識別問題(已知 bug),建議使用穩定版本 |

| 香港網絡下載速度 | 從 Ollama 官方伺服器下載,偶有速度不穩的情況(尤其 DeepSeek 等熱門模型剛發布時),可用斷點續傳解決 | 直接從 Hugging Face CDN 下載,配合香港寬頻一般可達較穩定速度;但 Hugging Face 本身偶爾訪問較慢,建議使用 VPN 或 Cloudflare DNS |

| 適合對象 | 開發者、技術人員、需要將 AI 整合入工作流程的進階用戶;想自動化任務的數碼行銷人 | 非技術用戶、剛入門本地 AI 的初學者、想快速試用不同模型的中小企業主及自由工作者 |

| 費用 | 完全免費開源 | 個人及商業用途免費(2025 年 7 月起);企業版另行收費 |

| 穩定性 | 整體穩定;已知有 VRAM 輕微洩漏問題,建議每日重啟一至兩次 | UI 體驗優秀,但個別版本升級後出現嚴重效能下降(如 0.3.27→0.3.28 版本),建議只使用穩定版本,勿輕易升級 |

2026 最新更新:你必須知道的變化

本地 AI 工具在 2025–2026 年間經歷了快速演變。以下是兩款工具最重要的最新動態:

Ollama 2025–2026 重大更新

原生桌面 App 正式推出(2025 年 7 月):Ollama 終於推出 macOS 及 Windows 桌面應用程式,支援拖放 PDF 及圖片直接互動,讓非技術用戶也能輕鬆上手。

Llama 4 Scout 及 Llama 4 Maverick 支援:Meta 最新 Llama 4 系列(採用 Mixture-of-Experts 架構)已可直接透過 ollama pull llama4 下載使用,支援多模態輸入。

DeepSeek R1 全面支援:DeepSeek R1 已在 Ollama 上穩定執行,支援 1.5B 至 70B 等多種參數版本,香港用戶可根據自己的電腦配置選擇合適大小。

Gemma 4 多模態支援:Google 最新 Gemma 4 可同時處理文字與圖像,已整合入 Ollama 模型庫。

雲端模型(Ollama Cloud)預覽:對本地硬件規格不足的用戶,Ollama 新增雲端執行選項,讓你繼續使用熟悉的 CLI 或 API,同時享用更大型的模型。

Secure Minions 協議:與 Stanford Hazy Research Lab 合作推出,讓本地模型與雲端模型安全協作,所有資料端對端加密,符合企業私隱需求。

DeepSeek R2 即將支援:DeepSeek R2(傳聞擁有 1.2 兆參數的 MoE 架構)一旦開源發布,預計 Ollama 將第一時間提供支援,屆時效能有望大幅超越 R1。

LM Studio 2025–2026 重大更新

完全免費(2025 年 7 月起):LM Studio 正式取消個人及商業使用收費,改以企業 SSO 功能作為收費項目。

版本 0.4.0 引入 headless server 模式:終於可以在無 GUI 的情況下作為 API 伺服器執行,彌補了與 Ollama 的最大功能差距。

Qwen 3 系列支援:Alibaba 最新 Qwen 3(包括 0.6B 至 235B 各種大小)均可在 LM Studio 瀏覽器中找到並下載。

LM Link 遠端連線:可透過網絡安全地遠端連線自己的 LM Studio 實例,適合香港用戶在外出時連接家中的高規格電腦。

Apple Silicon M5 Pro/Max 優化:官方確認在 M5 系列晶片上的 LLM 提示處理速度較上一代提升 4 倍。

網頁搜尋插件:新版 LM Studio 支援為模型加入即時網頁搜尋能力,讓本地模型也能獲取最新資訊。

香港用戶實際使用體驗

網絡下載:需有心理準備

香港擁有全球數一數二快速的固網寬頻,但下載大型 AI 模型(動輒 4GB 至 40GB)仍有一些注意事項:

Ollama 下載:部分熱門模型剛發布時(如 DeepSeek R1 剛推出期間),Ollama 伺服器曾出現壅塞,用戶反映下載中斷或速度異常緩慢。解決方法是使用 Ctrl+C 中斷後重新拉取(Ollama 支援斷點續傳),或考慮將 DNS 調整為 Cloudflare(1.1.1.1)。

LM Studio 下載:透過 Hugging Face CDN,香港一般寬頻環境下速度相對穩定,但 Hugging Face 有時訪問較慢,建議使用 VPN 或設定 Cloudflare DNS。

硬件選擇建議(香港市場常見配置)

電腦類型 推薦工具 可用模型

MacBook Pro M3/M4/M4 Pro Ollama 或 LM Studio 均可 7B–14B 模型(快速流暢)

Windows PC + RTX 4060(8GB VRAM) Ollama 或 LM Studio 7B 模型(良好速度)

Windows PC + RTX 4090(24GB VRAM) Ollama(更高效率) 最高 70B 模型

舊式 Intel Mac 只能用 Ollama 3B–7B 模型(速度較慢)

辦公室 Windows 電腦(無獨立顯示卡) LM Studio(CPU 模式) 3B–7B 模型

我應該用 Ollama 還是 LM Studio?決策矩陣

不確定應選哪一個?用以下決策矩陣對號入座:

選擇 Ollama,如果你是…

情境 原因

開發者或技術人員 REST API 整合方便,可直接嵌入應用程式或自動化工作流程

需要同時使用多個模型 支援多模型並行,API 切換靈活

使用 Intel Mac LM Studio 不支援 Intel Mac,Ollama 可以

想將 AI 整合入現有工具 Opera 瀏覽器、Microsoft PowerToys 等已原生支援 Ollama

希望 AI 工具在背景自動執行 Ollama 開機自動啟動,其他程式可直接調用

進階數碼行銷自動化 可配合 Python/Node.js 腳本,實現批次內容生成、SEO 分析自動化

選擇 LM Studio,如果你是…

情境 原因

完全沒有程式開發經驗的初學者 圖形介面直觀易用,零指令即可開始使用

想快速試用多款不同模型 內建 Hugging Face 瀏覽器,一鍵下載,視覺化管理

中小企業主,需要快速展示 AI 能力 精美介面讓展示更具說服力

想處理 PDF 文件分析 內建 PDF 讀取功能,操作簡單

企業環境,需要用戶管理 企業版提供 SSO 及模型存取控制

自由工作者,主要使用聊天介面 無需學習任何技術,即開即用

兩者都用?

事實上,不少進階用戶同時安裝兩款工具:用 LM Studio 探索和測試新模型,確定後再轉到 Ollama 整合入自動化工作流程。這是最靈活的做法。

常見問題 FAQ

Q1:Ollama 和 LM Studio 是完全免費的嗎?

是的,兩款工具個人使用完全免費。 Ollama 一直以來都是開源免費工具。LM Studio 自 2025 年 7 月起取消所有個人及商業使用費用,只有企業版(SSO 登入、模型存取管理等)另行收費。對於香港中小企業及個人用戶而言,兩者均無需任何費用。

Q2:我用 Mac 可以執行本地 AI 模型嗎?有什麼限制?

可以,但要注意機型。 如果你使用的是 Apple Silicon(M1、M2、M3、M4 系列)的 Mac,兩款工具都支援,而且 Apple 的 Metal GPU 加速效能表現相當出色。但如果你使用的是 Intel Mac,LM Studio 已不再支援,只能使用 Ollama。無論哪種 Mac,建議至少 16GB 統一記憶體(Unified Memory)才能流暢執行 7B 以上的模型。

Q3:在香港下載模型速度如何?會很慢嗎?

視模型大小和下載來源而定。 香港寬頻基礎建設優秀,理論上下載速度很快。實際上,LM Studio 透過 Hugging Face CDN 下載一般較穩定;Ollama 方面,熱門模型剛發布時可能出現伺服器壅塞。建議將 DNS 設定為 Cloudflare(1.1.1.1),可顯著改善下載速度。一個 7B 模型約需 4–5GB,以香港 500Mbps 固網計算,一般 5–10 分鐘內可完成下載。

Q4:本地 AI 模型和 ChatGPT 的差別是什麼?

最大差別在於私隱保護和成本。 本地 AI 模型(透過 Ollama 或 LM Studio 執行)所有運算都在自己的電腦完成,資料完全不會上傳到任何外部伺服器,非常適合處理機密商業資料。此外,一旦模型下載完成,使用成本為零,無需按月付費。缺點是效能受限於你的電腦硬件,而且最新、最強的模型通常仍是雲端服務(如 GPT-4o、Claude 3.5 Sonnet)。對於日常任務(文案撰寫、資料整理、中文翻譯),本地 7B–14B 模型已相當夠用。

Q5:DeepSeek 可以在 Ollama 和 LM Studio 上執行嗎?

可以,兩款工具都支援 DeepSeek 系列模型。 DeepSeek R1 已在 Ollama 及 LM Studio 上穩定執行,提供 1.5B、7B、14B、32B、70B 等多種參數版本。DeepSeek V3 同樣已獲支援。至於 DeepSeek R2,目前仍在準備發布階段,一旦開源,預計兩款工具都會迅速提供支援。香港用戶在下載 DeepSeek 模型時,如遇下載中斷,可嘗試使用斷點續傳(Ctrl+C 後重新執行 ollama pull)。

Q6:我完全沒有技術背景,是中小企業主,應該從哪裡開始?

建議從 LM Studio 開始。 對於完全沒有技術背景的用戶,LM Studio 的圖形介面最容易上手:下載安裝後,點擊「Search models」、選擇一個模型(推薦從 Llama 3.2 3B 或 Qwen 2.5 7B 開始)、下載後點擊「Load」,再到聊天介面直接使用,整個流程 15 分鐘內可完成。待你對本地 AI 有了基本了解後,再學習 Ollama 搭配 API 自動化,效益會更大。如想系統學習 AI 工具的應用,可參考下方的課程資訊。

Q7:Ollama 和 LM Studio 可以在 Windows 電腦上執行嗎?

兩款工具都支援 Windows。 Ollama 在 Windows 11 上執行穩定,支援 NVIDIA 及 AMD GPU 加速。LM Studio 同樣支援 Windows,建議使用 Windows 10 或以上版本。需要注意的是,若你的 Windows 電腦沒有獨立顯示卡,模型將以 CPU 模式執行,速度會比有 GPU 的機器慢很多,但仍可正常使用輕量型模型(3B 以下)。

想系統掌握 AI 工具?立即加入 hdcourse.com AI 課程

🎯 不只是會用工具,而是懂得將 AI 變成你的競爭優勢

光是會安裝 Ollama 或 LM Studio 是不夠的。真正的競爭優勢在於:懂得將 AI 工具整合入你的業務流程,為客戶創造實際價值。

hdcourse.com AI 課程由 Ivan So 親自教授,專為香港數碼行銷人、中小企業主及自由工作者設計:

- ✅ ChatGPT、Gemini、Claude 進階應用技巧

- ✅ AI 輔助文案、SEO、社交媒體內容製作

- ✅ 本地 AI 模型(Ollama / LM Studio)實戰教學

- ✅ AI 自動化工作流程設計

- ✅ 每月持續更新最新 AI 工具教學

月費只需 HK$197

隨時可以取消,無長期合約

關於作者

Ivan So|hdcourse.com 創辦人

Ivan So 擁有超過 20 年數碼行銷經驗,曾服務大中華區多家知名品牌及跨國企業。2010 年代起積極推動數碼行銷教育,創辦 hdcourse.com,致力以實戰角度教授最新 AI 及數碼工具。Ivan 深信科技應該為人服務,而非令人感到困惑,因此所有課程均以用戶實際需求為本,拒絕艱澀術語。Ivan 現居香港,長期關注本地企業數碼轉型發展。

總結:Ollama vs LM Studio 比較 — 2026 香港用戶最終建議

兩款工具各有所長,並無絕對優勝者。簡單來說:

LM Studio = 最佳入門工具,適合所有想「即開即用」的香港用戶,特別是非技術背景的中小企業主及自由工作者

Ollama = 最佳基礎架構,適合想將本地 AI 深度整合入工作流程的開發者及進階數碼行銷人

2026 年最大的改變是,兩款工具的差距正在縮小:Ollama 有了桌面 App,LM Studio 有了 headless 伺服器模式。選擇的關鍵不再是「哪一個功能更多」,而是你的實際需求是什麼。

如果你剛開始探索本地 AI 模型,不妨兩款都安裝,親身體驗後再決定哪款更符合你的工作方式。

本文最後更新:2026 年 | 如有最新工具更新,歡迎留言通知作者

相關文章:ChatGPT 使用教學 | AI 工具比較系列