5 大原因 DeepSeek-Coder-V2 勝過 GPT4-Turbo 在編程和數學測試中

在現今科技發展迅速的時代,人工智能(AI)模型的應用越來越廣泛。DeepSeek-Coder-V2 這款開源代碼語言模型,以其優異的編程和數學表現,超越了很多知名的專有模型,例如 GPT4-Turbo。以下將為大家介紹 DeepSeek-Coder-V2 的五大優勢。

1. 獨特的 Mixture-of-Experts 框架

DeepSeek-Coder-V2 採用了 Mixture-of-Experts (MoE) 框架,這使它在處理複雜的編程和數學問題時,能夠比其他模型更具效率。該模型有兩種配置:16 億參數(其中 2.4 億參數為活躍狀態)和 236 億參數(其中 21 億參數為活躍狀態)。

2. 廣泛的編程語言支持

DeepSeek-Coder-V2 支持多達 338 種編程語言,這使它在面對各種編程語言需求時,能夠提供更靈活且精確的解決方案。這對於開發者來說,無疑是一大福音。

3. 巨量數據集訓練

該模型使用了來自多種來源的 6 兆額外標籤進行訓練,這使它在處理複雜的編程和數學問題方面,具備更高的解析度和準確性。訓練數據集中包含 60% 的源代碼、10% 的數學語料和 30% 的自然語言語料,主要來源包括 GitHub 和 Stack Overflow 等。

4. 開源且商業和研究用途無限制

DeepSeek-Coder-V2 完全開源,並在寬鬆的許可下提供無限制的商業和研究用途。這意味著開發者和研究人員可以自由使用和調整這個模型,以適應不同的應用場景。

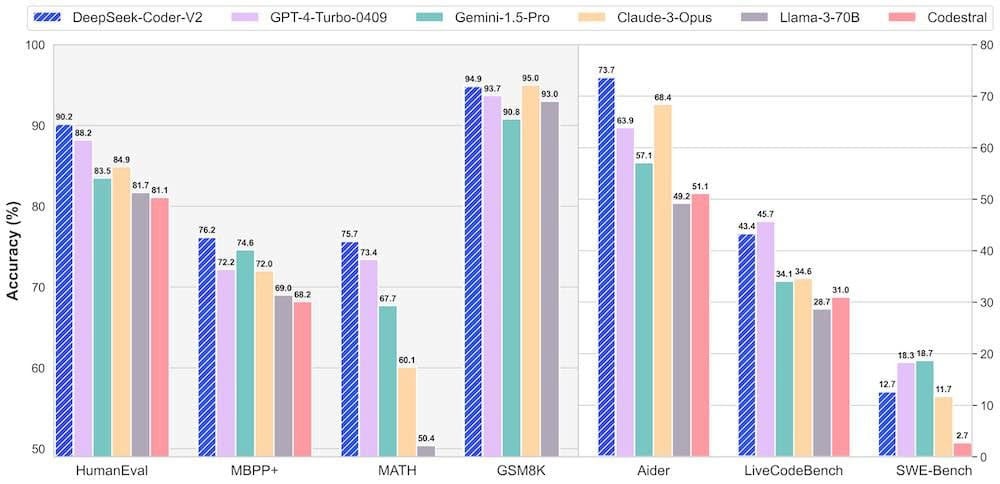

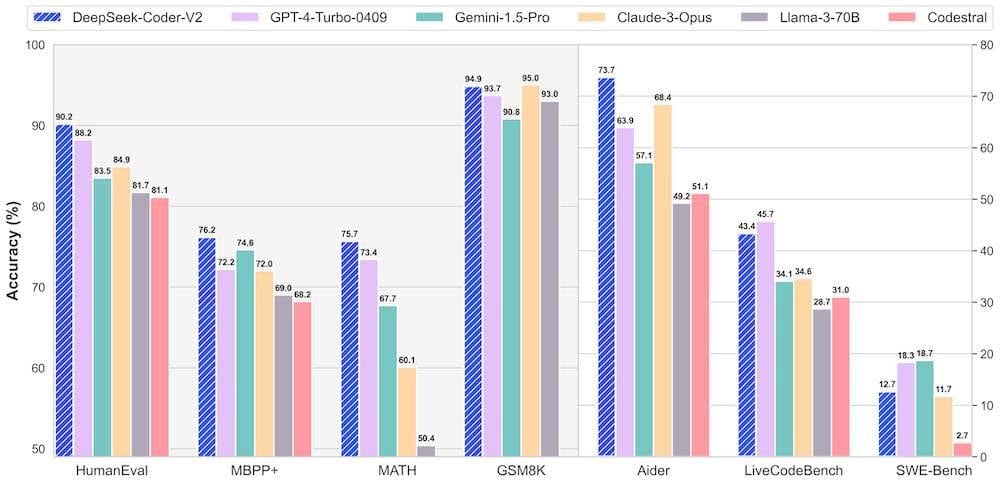

5. 卓越的性能指標和基準測試

在 HumanEval 基準測試中,DeepSeek-Coder-V2 得分達到 90.2%,而在 MBPP 基準測試中,得分則為 76.2%,創下了這些編程測試的新紀錄。此外,它在一般語言任務中的表現也相當穩健,與其前身及競爭模型相當。

性能指標表

| 性能指標 | DeepSeek-Coder-V2 | GPT4-Turbo |

|---|---|---|

| HumanEval 得分 | 90.2% | – |

| MBPP 得分 | 76.2% | – |

| 支持語言 | 338 種 | – |

| 最大上下文長度 | 128,000 標籤 | – |

DeepSeek-Coder-V2 的出現,無疑為編程和數學領域的人工智能應用帶來了一股新的力量。

結論

DeepSeek-Coder-V2 以其獨特的框架、廣泛的語言支持、巨量數據集訓練、開源特性以及卓越的性能指標,成功超越了 GPT4-Turbo 等知名專有模型。這款開源模型不僅在編程和數學方面展現了強大的實力,還為開發者和研究人員提供了更多的可能性和創新空間。

常見問題

1. DeepSeek-Coder-V2 是否適用於所有編程語言?

是的,DeepSeek-Coder-V2 支持多達 338 種編程語言,能夠滿足各種編程需求。

2. 這款模型是否免費使用?

DeepSeek-Coder-V2 完全開源,並在寬鬆的許可下提供無限制的商業和研究用途,開發者可以免費使用。